Yapay zekanın sağladığı birçok fayda, hayatımızı daha da kolaylaştırırken, kötü niyetli kişilerin bu teknolojiyi kötüye kullanma potansiyeli artmaktadır.

GPT-4o’nun görüntü oluşturma teknolojisi, sıradan bir resmi alıp, Studio Ghibli’nin eşsiz büyülü atmosferini yansıtan etkileyici sanat eserlerine dönüştürme konusunda olağanüstü bir yetenek sergilemektedir.

Bu yeni model, sadece bir filtre uygulamakla kalmayıp, pikselleri ayrı ayrı işleyerek sabırla ve robotik bir hassasiyetle tamamen yeni görüntüler üretmektedir.

Bu özelliği ile GPT-4o’nun oluşturduğu görseller, önceki modellerden olan DALL-E 3 gibi gürültüyü ortadan kaldırma yöntemlerini kullanan sistemlere kıyasla çok daha üstün sonuçlar vermektedir.

SANAT DÜNYASINDA TARTIŞMALAR VE ENDİŞELER YÜKSELİYOR

Bu son teknoloji, internet kullanıcıları arasında büyük bir heyecan uyandırırken, sanat camiasında da önemli tartışmalara neden olmaktadır.

Studio Ghibli’nin kurucu ortağı Hayao Miyazaki, yapay zeka ile üretilen görseller hakkındaki düşüncelerini açıkça ifade ederek, bu tür çalışmaları “hayatın kendisine bir hakaret” olarak nitelemektedir.

İnsan emeği ve yaratıcılığına dayalı animasyonların ustası olan Miyazaki’nin bu görüşleri, sanat çevrelerinde geniş yankı uyandırmaktadır.

Ancak kaygılar sadece sanatsal endişelerle sınırlı değildir. Teknoloji ilerledikçe, dolandırıcıların da bu araçları kötüye kullanma olasılığı artmaktadır.

SİGORTA DOLANDIRICILIĞINDA YENİ BİR DÖNEM

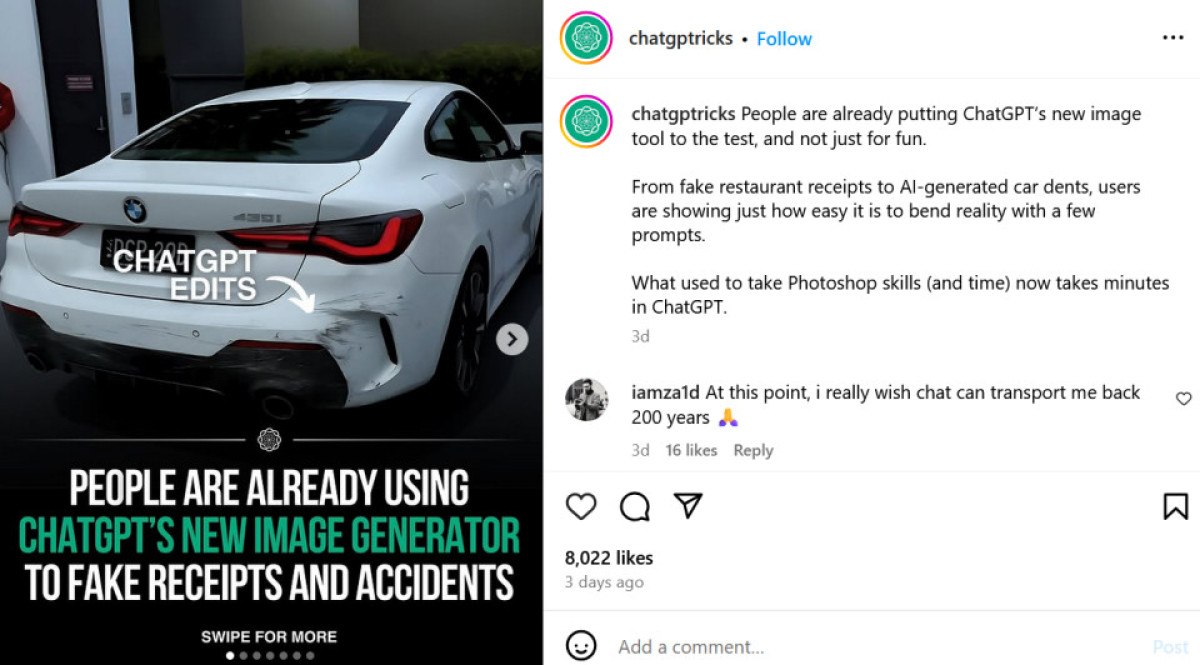

ChatGPT’nin görüntü oluşturma özelliğinin dolandırıcılık amacıyla kullanıldığına dair ilk raporlar gün yüzüne çıkmış durumdadır.

Reddit’in r/chatgptricks adlı alt kategorisinde viral olan bir paylaşımda, bir kullanıcı GPT-4o’yu kullanarak hasarlı bir BMW’nin sahte bir fotoğrafını nasıl ürettiğini detaylarıyla anlatmıştır.

Yapay zeka tarafından üretilen bu fotoğraf, inandırıcı çizikler, eğilmiş paneller ve gerçek bir otoparkla uyumlu aydınlatma gibi detayları içermekteydi.

Sadece araç hasarları değil, GPT-4o’nun iade dolandırıcılıkları için sahte makbuzlar, kaza sahneleri ve hatta ürün fotoğrafları üretmek için de kullanılabildiği belirtilmektedir.

Başlangıçta sadece yaratıcı bir ifade olarak ortaya çıkan bu teknoloji, hızla dijital dolandırıcıların elinde tehlikeli bir araç haline gelmektedir.

Bu gelişmeler, hukuk uzmanlarını da yeni ve keşfedilmemiş alanlara yöneltmektedir. Sanatsal tarzlar doğrudan yasal olarak korunmasa da, bir Ghibli filmi atmosferinin kopyalanması, yaratıcıları fikri mülkiyet sınırlarına yaklaştırabilir.

Telif hakkına tabi eserlerden belirli unsurların yeniden üretilmesi ise henüz belirsiz bir alan olarak kabul edilmektedir.